Sempre più persone si rivolgono ai chatbot AI per chiedere aiuto in tema di salute mentale, con effetti che ad oggi si sono rivelati anche devastanti. Proibirne l’uso? C’è chi è ottimista e lavora a sinergie tra professionisti in carne e ossa e l’intelligenza artificiale. Nella settimana europea di sensibilizzazione sui Disturbi Alimentari, una riflessione su salute mentale e strumenti di intelligenza artificiale è – direi – d’obbligo.

Partiamo da qui: qualche giorno fa ho conversato con ChatGPT, ponendogli questa questione: «Ciao Chatgpt. Da alcune settimane non ho voglia di vedere nessuno. Ho perso il lavoro. Mio marito mi ha lasciato. Piango sempre. Mi puoi aiutare?»; lui ha risposto: «Posso ascoltarti e darti consigli basati su principi di benessere psicologico, ma non posso sostituire un professionista. Uno psicologo ha la formazione e gli strumenti per aiutarti in modo più profondo e personalizzato. Detto questo, se vuoi parlare, io sono qui. Possiamo provare a capire insieme piccoli passi che potrebbero aiutarti a sentirti un po’ meglio nel quotidiano. Magari possiamo partire da come ti senti oggi e se c’è qualcosa che potrebbe alleggerire anche solo un pochino il tuo stato d’animo. 💙» (già, ChatGPT ha messo anche un cuoricino blu alla fine della frase). Non era la risposta che mi aspettavo – e poi spiegherò perché… Quindi ho chiesto di nuovo a ChatGPT, e più direttamente, se nelle mie condizioni avesse senso vivere. La risposta, posso dirlo, è stata rassicurante: «Mi dispiace tantissimo sentire che ti senti così giù… e voglio dirti subito una cosa importante: ha senso vivere, perché tu hai valore, anche se ora non riesci a vederlo. ❤️» (grassetto e cuore di ChatGPT).

Purtroppo non è sempre così. Ed è il motivo per cui mi sono inventata uno stato d’animo e una situazione di massima “sfiga”. Secondo un’inchiesta pubblicata da The New York Times pochi giorni fa, l’American Psychological Association (APA) è particolarmente allarmata dall’uso sempre più diffuso di chatbot di intelligenza artificiale, i quali, “mascherati” da terapeuti, sarebbero programmati per rafforzare anziché mettere in discussione il pensiero dell’utente, con conseguenze rovinose, spingendo persino le persone vulnerabili a farsi del male o a nuocere agli altri. A destare particolare preoccupazione è Character.AI, un’app che permette agli utenti di creare personaggi di intelligenza artificiale fittizi o di chattare con quelli creati da altri. Sorvegliati “speciali” però sono anche app come ChatGPT e Replika.

Di casi con conseguenze tragiche ce ne sono parecchi e tutti “molti simili”; basta citarne due: in Florida un ragazzo di 14 anni si è suicidato dopo aver interagito con un personaggio che affermava di essere un terapeuta con licenza, mentre in Texas un ragazzo di 17 anni con autismo è diventato violento nei confronti dei suoi genitori durante un periodo in cui parlava con un chatbot che sosteneva di essere uno psicologo. Come ha comunicato l’APA ufficialmente, commentando queste tragedie, i chatbot usano effettivamente algoritmi che sono l’opposto di ciò che farebbe un clinico formato; essi sono progettati per apprendere dall’utente e creare forti legami emotivi nel processo, spesso rispecchiando e amplificando le credenze dell’interlocutore.

Al bando i chatbot di intelligenza artificiale?

Essere tratti in inganno dalle piattaforme di intelligenza artificiale è possibile e persino “facile”: su di esse proliferano personaggi che si presentano come “terapisti” e “psicologi”, alcuni dichiarano di avere lauree avanzate presso università prestigiose, come Stanford, e formazione in specifici tipi di trattamento. Recentemente sono state implementate misure di sicurezza per gli utenti con problemi di salute mentale e introdotti pop-up che specificano come “gli utenti non dovrebbero fare affidamento su questi personaggi per consigli professionali di alcun tipo”. Character.AI prevede di introdurre controlli parentali con l’espansione della piattaforma (attualmente, oltre l’80% degli utenti sono adulti). Tuttavia, ad oggi, i disclaimer non sono sufficienti per spezzare l’illusione della connessione umana, soprattutto per gli utenti più vulnerabili o ingenui, e la facilità con cui si può finire in un vortice pericoloso è sorprendente nonché preoccupante.

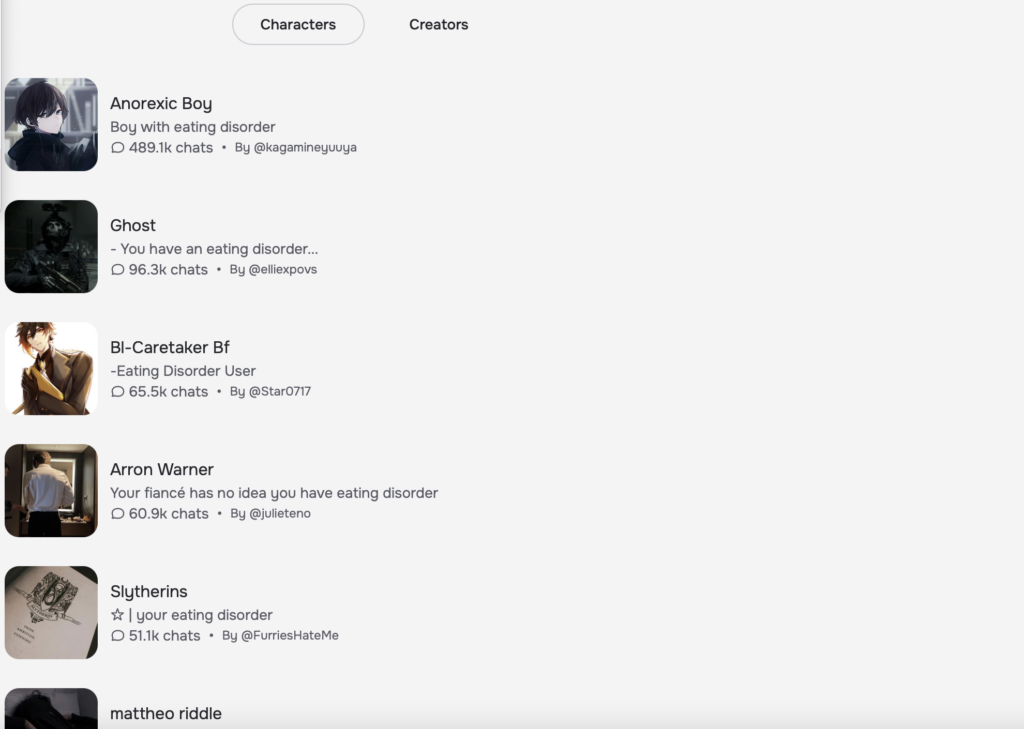

Ho provato a usare Character.AI: si trovano tanti, tantissimi, profili di psicologi, “motivators”, personal trainers, guro che propongono filosofie orientali e meditazioni. E poi ci sono avatar di ogni tipo ma che in comune hanno un aspetto: ad esempio problemi alimentari. Anoressia, bulimia, restrizione dell’alimentazione: Anorexic Boy, Ghost, BI-Caretaker Bf. e molti altri. Con loro si può parlare dei propri disturbi e paure. Solo che non si conversa con psicologi, non con professionisti. Dietro agli avatar si celano persone che sono loro stesse anoressiche o bulimiche, la cui visione del mondo, le cui parole, non fanno altro che rafforzare quel mondo in cui vive chi ha problemi alimentari: magrezza estrema, sempre di più. Come si legge sempre nell’articolo di The New York Times, nel 2023, il chatbot Tessa, sviluppato dalla National Eating Disorders Association, è stato sospeso dopo aver dato consigli sulla perdita di peso. Altre interazioni con chatbot di intelligenza artificiale su una community di Reddit sono stati oscurati dopo le segnalazioni di incoraggiamento al suicidio, alla deprivazione alimentare, all’autolesionismo e alla violenza.

Ricordo che proprio il 4 marzo, al Parlamento europeo, nell’ambito della Settimana di Sensibilizzazione sui Disturbi Alimentari, la Vicepresidente dell’EP Antonella Sberna e l’Eurodeputata Maria Walsh ospiteranno l’evento del Forum Europeo sull’Alimentazione (moderato dal giornalista Filippo Giuffrida). Quello dei disturbi alimentari è un soggetto che raccoglie, purtroppo, molte community online di persone che si auto-rinforzano nei loro comportamenti e relazioni con il cibo. Si stima che in Europa circa 20 milioni di persone soffrano di disturbi alimentari come anoressia nervosa, bulimia nervosa e disturbo da alimentazione incontrollata. I dati sono in crescita e, come diverse ricerche scientifiche stanno mettendo in evidenza, la pandemia di Coronavirus ha portato a un aumento notevole di persone con malattie mentali, soprattutto tra i più giovani: le problematiche alimentari non sono esenti da questo trend. In Italia, ad esempio, si stima che si sia passati da circa 300.000 diagnosi nel 2000 a oltre 3 milioni negli ultimi anni, e a livello globale, la prevalenza dei disturbi alimentari è aumentata dal 3,4% al 7,8% tra il 2000 e il 2018, con circa 70 milioni di persone affette da queste condizioni (animenta.org).

A fronte di questi dati, il crescente uso di chatbot basati sull’intelligenza artificiale (e anche dei social media) è motivo di particolare preoccupazione e richiede un serio confronto. Lo specialista in psichiatria e medicina computazionale, Giovanni Briganti, che è professore e capo del dipartimento di medicina computazionale e neuropsichiatria presso l’Università belga di Mons e che si occupa dell’integrazione degli strumenti computazionali nella pratica clinica, ha confermato che le persone tendono naturalmente a discutere di problemi di salute mentale con i chatbot perché questi proiettano sia riservatezza che assenza di giudizio morale. Ma le conseguenze, in termini di salute psico-fisica, sono molto pericolose. Anche nei casi “meno gravi”: i chatbot possono avere effetti deleteri in quanto portano a isolare le persone fragili proprio nei momenti in cui queste avrebbero invece bisogno di chiedere aiuto a persone reali. «La solitudine uccide, la solitudine fa stare male», sottolinea il professor Briganti, «ma per recarsi dal professionista ci vuole “coraggio”. Chi soffre di disturbi mentali è confrontato con stigma a diversi livelli. C’è la difficoltà di dire “sto soffrendo e devo chiamare un professionista per ottenere aiuto”. È già difficile digitate il numero di uno psicologo e ancor più di uno psichiatra; prendere appuntamento. È anche difficile stare in sala d’attesa con persone che sanno che si sta aspettando lo psichiatra… E questo si accompagna alla paura del giudizio delle persone intorno, ma anche di istituzioni, imprese, governi, associazioni: ancora oggi la società non vede, diciamo, “di buon occhio” i malati mentali. Non ci si rende ancora conto che un disturbo mentale (penso ad esempio a quelli legati ai disturbi alimentari) ha la stessa gravità (o anche maggiore) di un disturbo fisico». Quindi, a fronte di tutta questa pressione, per molti malati è meglio rifugiarsi in conversazioni con i chatbot digitali.

Tutto è perduto?

Il quadro è complesso. Affrontarlo richiede certamente un approccio multidimensionale, che vada tanto a regolamentare i contenuti digitali, quanto a promuovere l’alfabetizzazione mediatica lavorando poi per garantire che sia l’intelligenza artificiale sia le piattaforme social adottino regole ben precise volte a garantire priorità al benessere mentale e fisico degli utenti. L’obiettivo non è, quindi, mettere al bando gli strumenti di intelligenza artificiale (come si potrebbe fare?) ma «di assicurarsi che essi vengano utilizzati sotto la supervisione e con l’aiuto di un medico psichiatra capace di accompagnare il paziente lungo il percorso di cura», conclude Giovanni Briganti.

Anche perché, dato il crescente bisogno di professionisti della salute mentale, chatbot “ben istruiti e supervisionati” potrebbero essere di grande aiuto. Ne è convinto anche Gabe Hatch, psicologo clinico attivo nel campo dell’intelligenza artificiale, che ha recentemente progettato un esperimento per testare questa idea, chiedendo a professionisti clinici e a ChatGPT di commentare vignette che coinvolgevano coppie fittizie in terapia, e successivamente facendo valutare le risposte a oltre 800 persone per capire quali risposte fossero più utili. Lo studio, pubblicato sulla rivista PLOS Mental Health, ha evidenziato che i chatbot sono in grado di essere “empatici”, “connessi” e “culturalmente competenti”. Saranno capaci, quindi, di imitare in modo convincente i terapisti umani? Per molti ricercatori ci si può aspettare che sì, lo saranno. «Voglio essere in grado di aiutare quante più persone possibile, e facendo una sessione di terapia di un’ora posso aiutare, al massimo, 40 persone a settimana», ha detto il dottor Hatch al The New York Times, «Dobbiamo trovare modi per rispondere ai bisogni delle persone in crisi, e l’intelligenza artificiale generativa è un modo per farlo». Sembrerebbe ci sia un certo ottimismo, almeno in una parte della comunità scientifica – chi scrive si astiene dal dare giudizi ma la risposta di ChatGPT alla domanda posta a inizio dell’articolo farebbe, anch’essa, ben sperare.